DeepSeek近日宣布推出兩款全新開源大模型——DeepSeek-V3.2與DeepSeek-V3.2-Speciale,標志著開源社區(qū)在復雜推理任務領域?qū)崿F(xiàn)重大突破。這兩款模型不僅在性能上比肩國際頂尖閉源系統(tǒng),更通過技術創(chuàng)新重新定義了開源模型的能力邊界,為全球開發(fā)者提供更高效的AI解決方案。

技術團隊在發(fā)布的報告中指出,當前開源模型與閉源系統(tǒng)在復雜任務處理能力上的差距正持續(xù)擴大。通過深度分析發(fā)現(xiàn),這種分化主要源于三大技術瓶頸:傳統(tǒng)注意力機制在長序列處理中的效率低下、后訓練階段計算資源投入不足,以及AI智能體(Agent)在泛化能力與指令遵循方面的顯著滯后。針對這些挑戰(zhàn),DeepSeek研發(fā)團隊提出三項關鍵技術革新:引入DSA稀疏注意力機制、構建可擴展強化學習框架,以及開發(fā)大規(guī)模Agent任務合成流程。

作為基礎版本,DeepSeek-V3.2在平衡推理能力與輸出效率方面表現(xiàn)突出。在公開基準測試中,該模型達到GPT-5水平,較前代版本輸出長度降低40%,顯著減少計算開銷。在代碼生成任務中,V3.2在SWE-bench Verified和Terminal Bench 2.0測試集上超越多數(shù)開源模型,展現(xiàn)出處理真實編程場景的潛力。其獨特的思考模式支持與Claude Code生態(tài)兼容,開發(fā)者可通過簡單配置啟用多輪推理工具調(diào)用功能。

性能強化版DeepSeek-V3.2-Speciale則將推理能力推向新高度。該模型整合數(shù)學定理證明模塊,在IMO 2025、CMO 2025等國際頂級數(shù)學競賽中斬獲金牌,同時在ICPC世界總決賽和IOI信息學競賽中表現(xiàn)優(yōu)異。測試數(shù)據(jù)顯示,Speciale版本在主流推理基準上與Gemini-3.0-Pro持平,但需消耗更多計算資源。目前該模型僅開放研究用途,暫未針對日常對話場景優(yōu)化。

技術實現(xiàn)層面,DSA稀疏注意力機制通過動態(tài)權重分配將計算復雜度降低60%,使模型在保持性能的同時支持更長上下文處理。強化學習框架突破性地將后訓練計算預算提升至預訓練階段的12%,解鎖高級推理能力。大規(guī)模任務合成流程生成超過1800個專業(yè)場景和8.5萬條復雜指令,通過強化學習顯著提升模型泛化能力。這些創(chuàng)新使V3.2在搜索Agent評估中超越多數(shù)開源系統(tǒng),工具調(diào)用準確率提升35%。

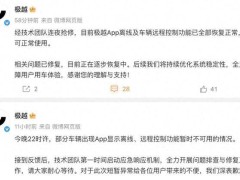

當前用戶可通過官方網(wǎng)頁端、移動應用及API接口體驗DeepSeek-V3.2,其中API服務提供限時Speciale版本調(diào)用。技術報告特別強調(diào),盡管V3.2在世界知識廣度上仍落后于閉源模型,但其單位計算成本效益顯著優(yōu)于同類產(chǎn)品。研究團隊同時指出,探索串并行擴展的最佳組合將成為后續(xù)優(yōu)化重點,以進一步提升模型訓練效率。